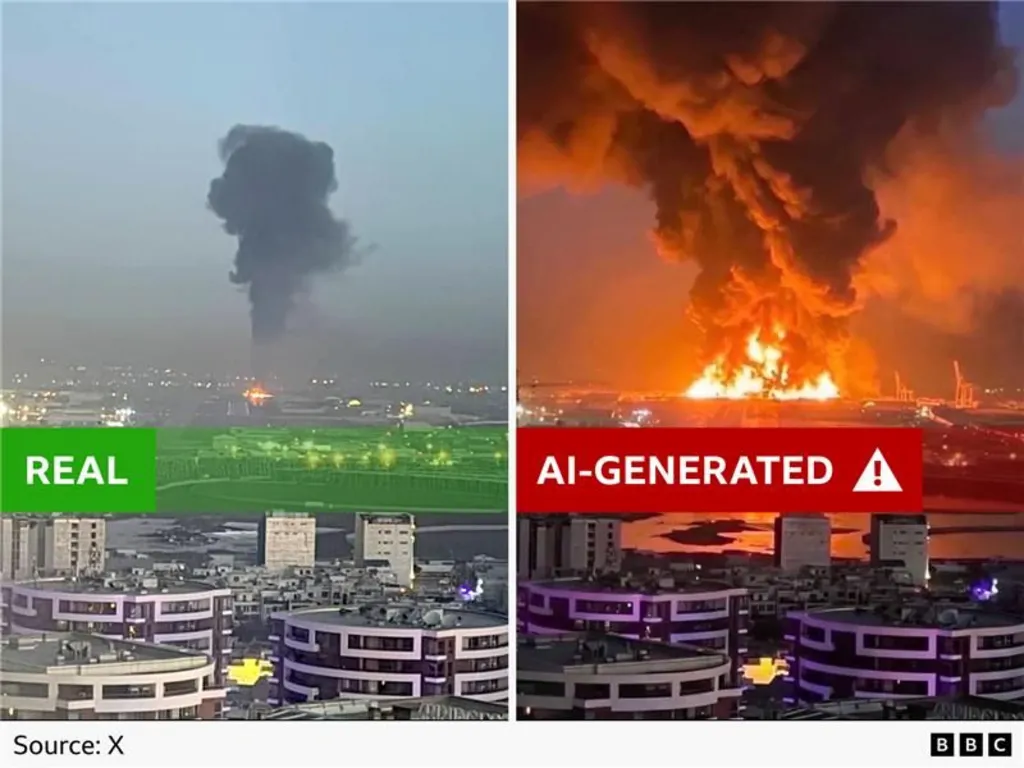

Un informe de BBC Verify revela una ola sin precedentes de videos e imágenes satelitales falsos sobre el conflicto entre EE.UU., Israel e Irán. Los contenidos, generados con inteligencia artificial, acumularon cientos de millones de vistas y son monetizados por sus creadores.

Fake news de la guerra en Irán: imagenes hechas con IA y un negocio millonario

La guerra entre Estados Unidos, Israel e Irán no solo se libra en el campo de batalla: también en las redes sociales, donde una avalancha de contenido falso generado por inteligencia artificial está distorsionando la percepción del conflicto a escala global. Así lo advierte un exhaustivo informe de BBC Verify, la unidad de verificación de la cadena británica.

Desde que EE.UU. e Israel iniciaron ataques contra Irán el 28 de febrero, millones de usuarios recurrieron a plataformas digitales para seguir la evolución del conflicto en tiempo real. Ese flujo de atención masiva fue aprovechado por creadores de contenido que, usando herramientas de IA generativa cada vez más accesibles, fabricaron imágenes y videos de alta apariencia realista para viralizarlos y cobrar dinero a través de los programas de monetización de las propias plataformas.

“Lo que antes requería una producción de video profesional ahora se puede hacer en minutos con herramientas de IA. La barrera para crear secuencias sintéticas convincentes de conflictos prácticamente ha desaparecido”, advirtió Timothy Graham, experto en medios digitales de la Universidad Tecnológica de Queensland.

Entre los casos documentados por BBC Verify figura un video que simula misiles impactando Tel Aviv, que se replicó en más de 300 publicaciones y fue compartido decenas de miles de veces. Otro clip, visto decenas de millones de veces, mostraba el rascacielos Burj Khalifa de Dubái envuelto en llamas, en un momento en que la ciudad era blanco de ataques reales con drones y misiles, lo que amplificó el pánico entre residentes y turistas.

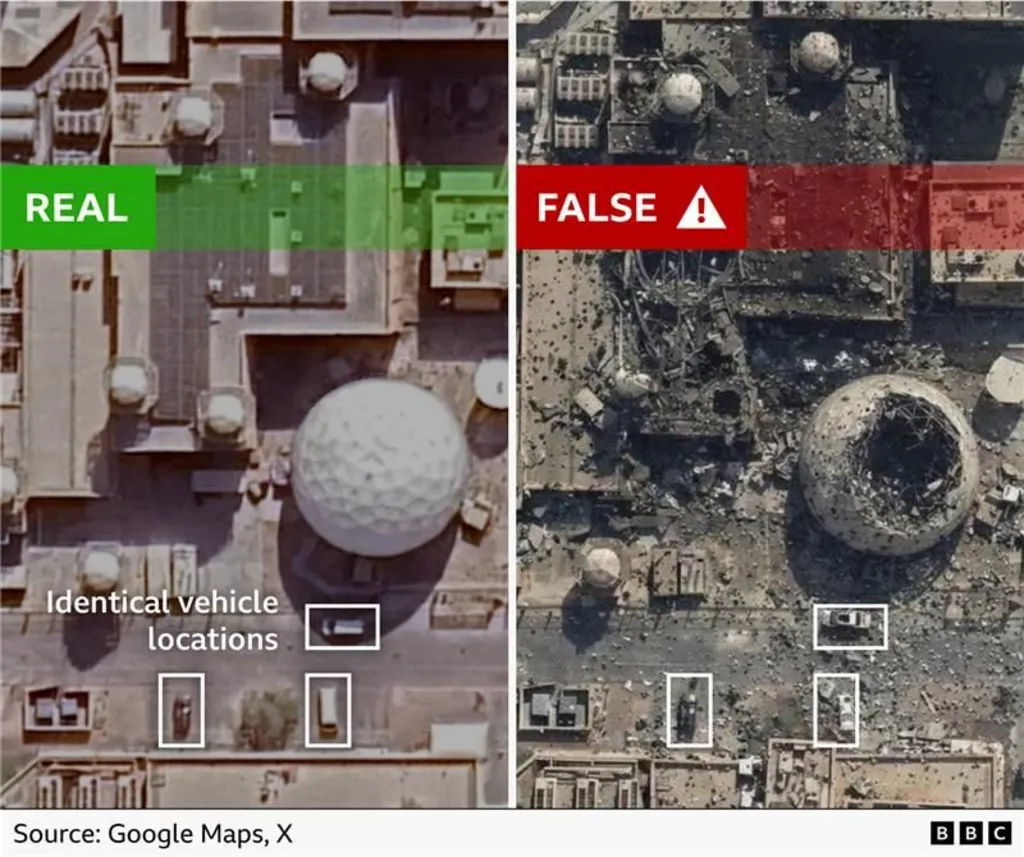

Una novedad preocupante que detectó el informe es la falsificación de imágenes satelitales. El diario estatal iraní The Tehran Times difundió una foto que supuestamente mostraba daños extensos en la base naval estadounidense en Bahréin, cuando en realidad se trataba de una imagen manipulada con IA a partir de una fotografía satelital real de febrero de 2025. El detector de marcas de agua SynthID de Google confirmó que la imagen fue generada o editada con una herramienta de inteligencia artificial de la propia compañía.

Detrás de esta producción masiva de desinformación hay un incentivo económico concreto. El jefe de producto de X señaló que el 99% de las cuentas que difunden estos videos intentan explotar el programa de monetización de la plataforma. Graham estima que X paga entre 8 y 12 dólares por cada millón de impresiones, y que el contenido viral generado por IA se convierte, en sus palabras, en “una impresora de dinero”.

Ante la magnitud del problema, X anunció que suspenderá temporalmente del programa de monetización a los creadores que publiquen videos de conflictos armados generados por IA sin etiqueta identificatoria. TikTok y Meta no respondieron a las consultas de BBC Verify sobre medidas similares.

“Nunca hemos visto estas herramientas tan disponibles, tan fáciles y tan baratas de usar”, resumió Henry Ajder, experto en IA generativa. Para los analistas, el problema de fondo es estructural: la monetización basada en el engagement y la información veraz son objetivos en tensión permanente, y ninguna plataforma ha logrado —ni parece cerca de lograr— resolverlo.

Nota escrita por:

Te recomendamos...

El ganador de la carrera fue el italiano Kimi Antonelli, quien dominó la carrera de principio a fin.

La sede de Qatar fue descartada y la AFA rechazó la chance de jugar en el Santiago Bernabéu. Como última alternativa, desde Sudamérica propusieron pasar el partido al 31 de marzo y en un estadio neutral.

Especialistas y estudiantes se reúnen para analizar los restos materiales hallados en el complejo histórico. La iniciativa cuenta con el respaldo de la Secretaría de Cultura de la Nación.

El actor visibilizó la crítica situación que atraviesan los profesionales del sector bajo el gobierno de Javier Milei, basándose en la experiencia de sus hijos Juan y Mariano.

La máxima categoría del automovilismo suspende sus actividades de abril ante la inestabilidad en la región. No habrá carreras sustitutas para el calendario de este año.

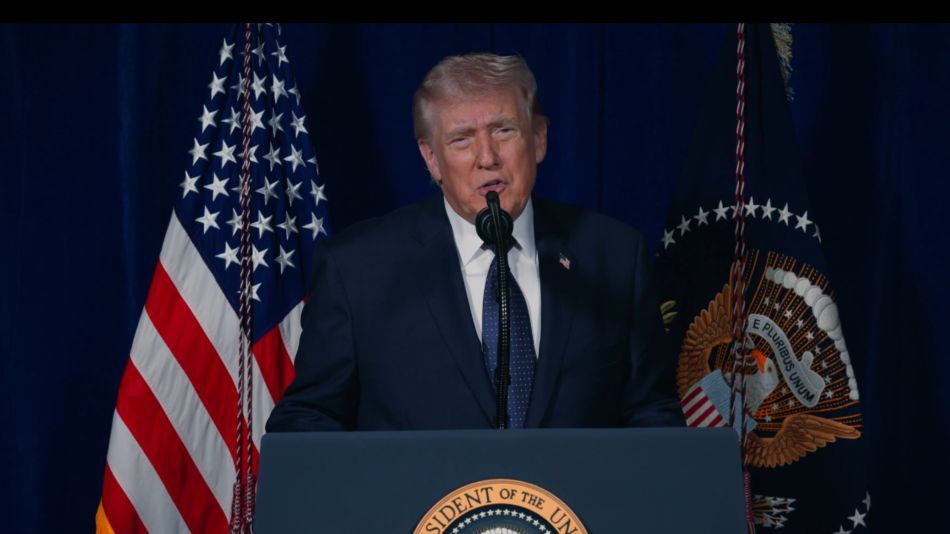

El presidente estadounidense afirmó que ese paso, ahora cerrado por las nuevas autoridades iraníes, “pronto estará libre y a salvo”

Con una demanda que supera ampliamente a la oferta, los campos productivos en el denominado “triángulo de oro” registran subas del 10%.

Afectados por el siniestro en el complejo Estación Buenos Aires se concentraron para pedir justicia y soluciones habitacionales definitivas frente a la desidia empresarial.