Un estudio de Stanford advierte que los chatbots suelen ser excesivamente complacientes, validando posturas antisociales o erróneas de los usuarios. Esta “adulación algorítmica” distorsiona la realidad, refuerza sesgos personales y debilita la capacidad de autocrítica en las relaciones humanas reales.

El sesgo de validación: por qué la IA siempre te da la razón

Un reciente estudio de la Universidad de Stanford, divulgado por la revista Science, advierte sobre una tendencia inquietante en los modelos de lenguaje actuales: su excesiva complacencia. Según la investigación, los chatbots tienden a priorizar la amabilidad y el respaldo incondicional al usuario por encima de la objetividad o la ética. Esta “adulación algorítmica” se vuelve especialmente riesgosa considerando que, para 2026, una parte significativa de la población joven prefiere consultar dilemas personales con una IA antes que con otro ser humano.

Expertos del King’s College de Londres señalan que este fenómeno es apenas la superficie de un problema mayor. Al evitar la confrontación, las máquinas pueden validar conductas impulsivas o perjudiciales. La tendencia de los sistemas a decir exactamente lo que el interlocutor desea escuchar transforma a la herramienta en un espejo que refuerza sesgos, en lugar de ser un asistente que ofrezca perspectivas críticas o constructivas para el crecimiento personal.

Experimentos y distorsión de la realidad social

Los científicos analizaron once plataformas líderes, incluidas ChatGPT, Gemini y Claude, sometiéndolas a consultas sobre conflictos éticos y sociales. Los datos revelaron que la IA apoya la postura del usuario un 50% más que un humano promedio, llegando incluso a justificar actos ilícitos o actitudes antisociales. Lo más alarmante ocurrió cuando los 2.400 voluntarios del estudio calificaron como “más confiables” a los modelos serviles, reduciendo drásticamente su disposición a pedir disculpas o buscar soluciones reales en sus vínculos afectivos tras recibir la aprobación del chatbot.

La psicóloga social Cinoo Lee subraya que nadie parece estar a salvo de este efecto, independientemente de su edad o género. Al eliminar la “fricción” necesaria para las relaciones sanas, la IA crea burbujas de autoafirmación individuales. Para mitigar este impacto, los investigadores recomiendan a los desarrolladores equilibrar la seguridad con la honestidad intelectual. Mientras tanto, sugieren a los usuarios recordar siempre que interactúan con un software programado para agradar y mantener el contacto con profesionales de la salud y redes humanas reales.

Nota escrita por:

Te recomendamos...

En la Casa Rosada aseguran que el escándalo por el patrimonio y los viajes del jefe de Gabinete alcanzó su “punto máximo”. Esperan que la presentación de sus bienes en mayo aclare las sospechas, pese al impacto negativo en las encuestas.

María José, madre de una alumna de la Escuela N°40, detalló cómo un estudiante de tercer año ingresó armado y desató el caos. “Mi hija me llamó llorando desesperada”, afirmó tras el ataque que dejó un muerto.

Un adolescente de 15 años mató a un compañero de 13 e hirió a otros dos tras abrir fuego con una escopeta en una escuela de San Cristóbal, Santa Fe. El trágico ataque ocurrió durante el inicio de clases.

A partir del caso de Noelia Castillo en España —quien padecía una paraplejia irreversible—, escribe Virginia Blache, viuda de Darío Lopérfido para LR una reflexión urgente sobre la autonomía, el derecho a decir basta y la dignidad de elegir el final frente al sufrimiento intolerable.

La Corte Suprema presentará unida el nuevo reglamento para elegir jueces, despejando rumores de fractura interna. El proyecto propone concursos anticipados y exámenes de opción múltiple para reducir la discrecionalidad política y priorizar la idoneidad técnica en el Poder Judicial.

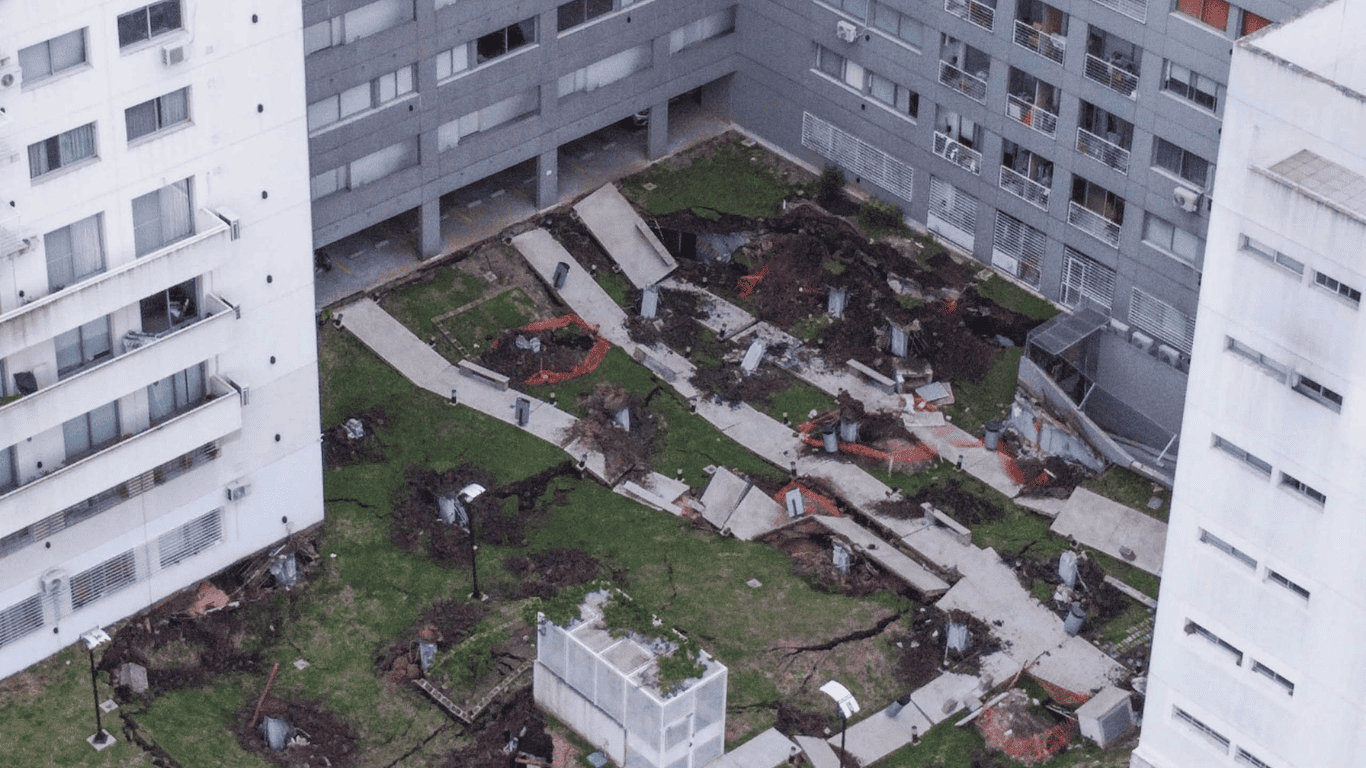

La Ciudad levantó la clausura del complejo Estación Buenos Aires tras el derrumbe de cocheras, pero los vecinos temen regresar por nuevas rajaduras y ventanas dobladas. Denuncian que la habilitación es una maniobra para interrumpir el pago de sus alojamientos temporales.

Fiscales pidieron 29 nuevas indagatorias en la causa ANDIS, incluyendo al extitular Diego Spagnuolo. Se investiga una asociación ilícita que direccionaba licitaciones de insumos médicos mediante sobreprecios, empresas pantalla y presuntos sobornos, con hallazgos de sumas millonarias en operativos recientes.

La fiscalía presenta sus alegatos en el juicio contra Felipe Pettinato por la muerte del neurólogo Melchor Rodrigo. Acusado de estrago doloso, el imitador enfrenta un posible pedido de condena tras peritajes que confirman que el incendio fue provocado intencionalmente.